智能驾舱中情感认知与调节研究

围绕智能驾舱中的情感认知与调节,本项目致力于构建“感知-认知-调节”闭环系统,推动智能驾舱向更安全、更舒适、更人性化的方向发展。

情感的认知与调节是智能驾舱一项关键能力

随着智能驾驶技术的快速发展,驾舱正从功能型向智能情感交互型转变。本项目围绕智能驾舱中的情感认知与调节展开系统研究,旨在提升驾乘体验与行车安全。研究内容包括三个方面:

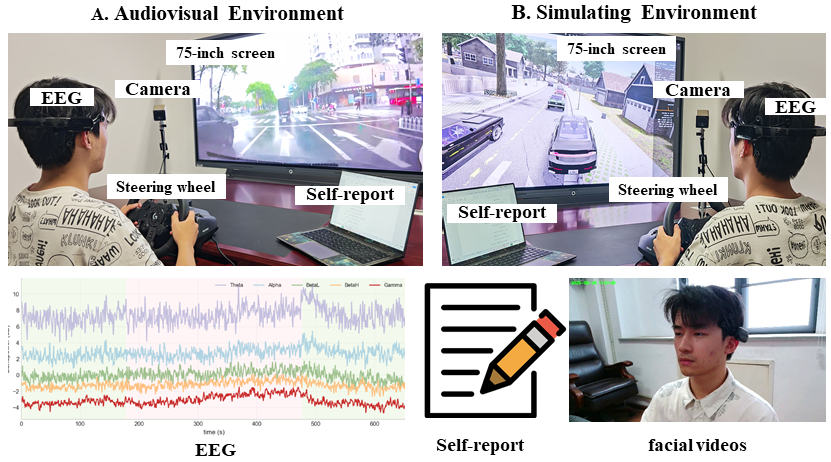

一、情感认知与调节数据库:构建了面向驾驶场景的情感认知与调节多模态数据库,核心含自建的 Synthetic(280 万张可控面部表情图)、R³-Ftg(真实驾驶情绪诱发)、Be(多模态情绪响应)数据集,为车内情绪感知与智能干预系统研发提供支撑。

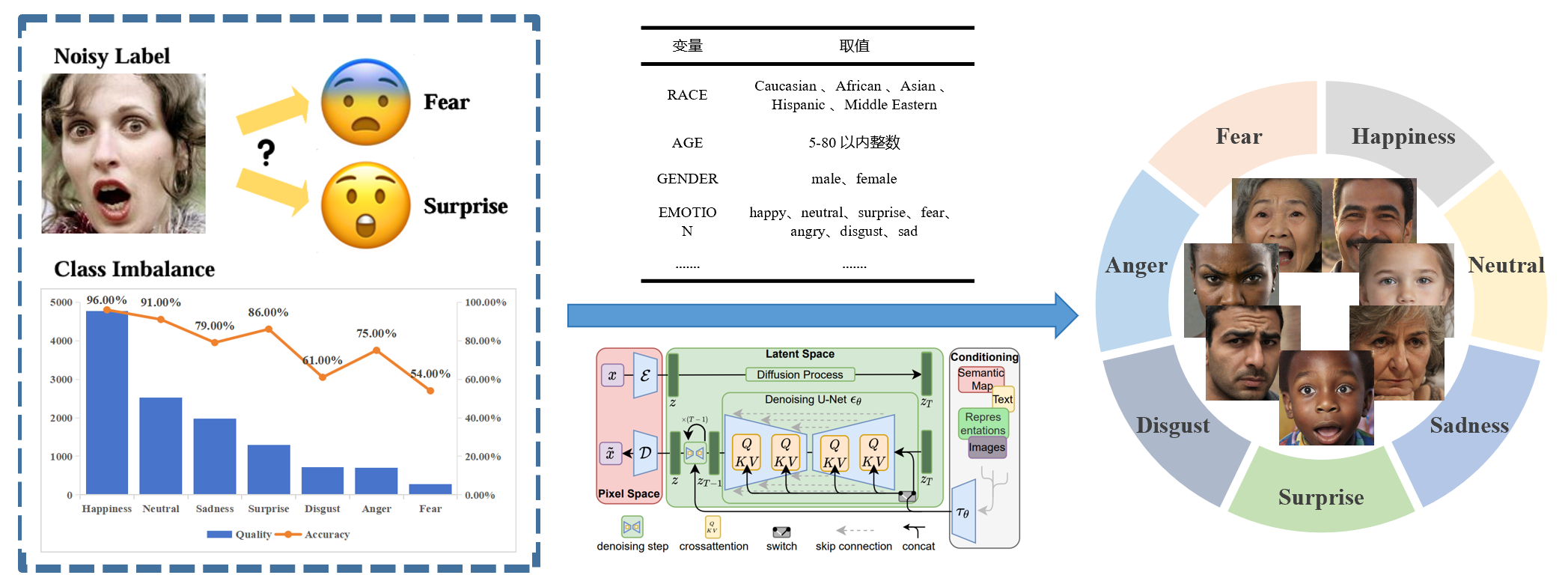

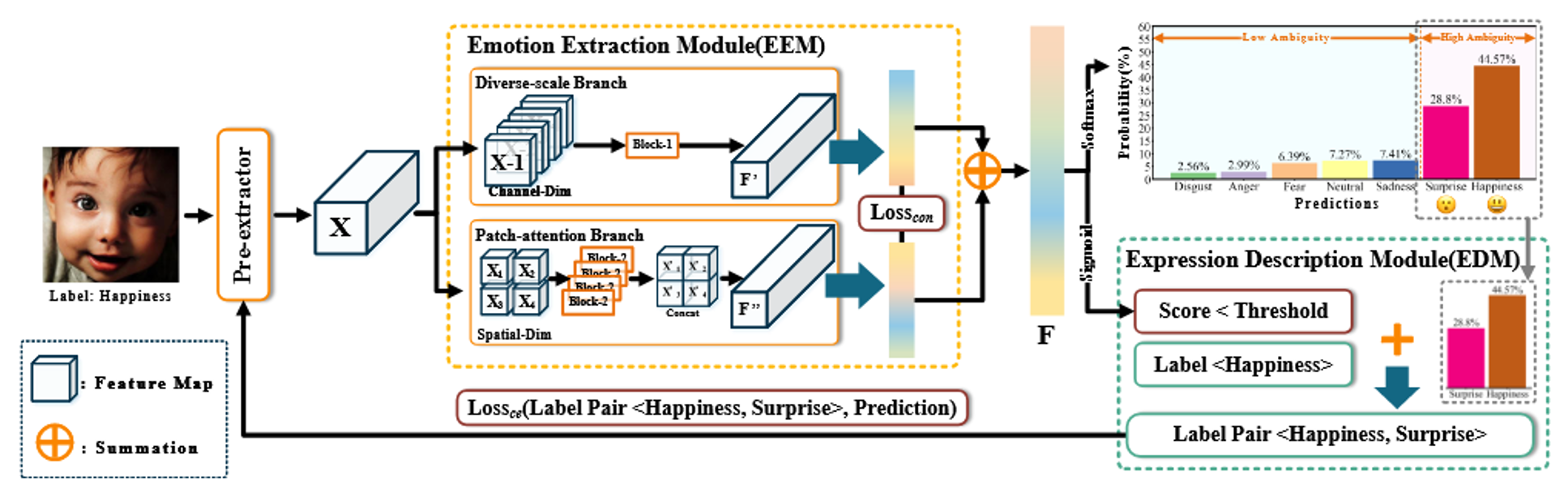

二、识别与调节模型:本研究针对面部表情识别(FER)标签噪声与数据不均衡问题,提出 ReSup 框架(双网协同提升噪声判定可靠性)、“与模糊性共舞” 鲁棒范式及合成数据驱动基础模型,形成 “噪声抑制→模型鲁棒→基础模型泛化” 技术闭环,为高精度表情识别提供理论与技术支撑。

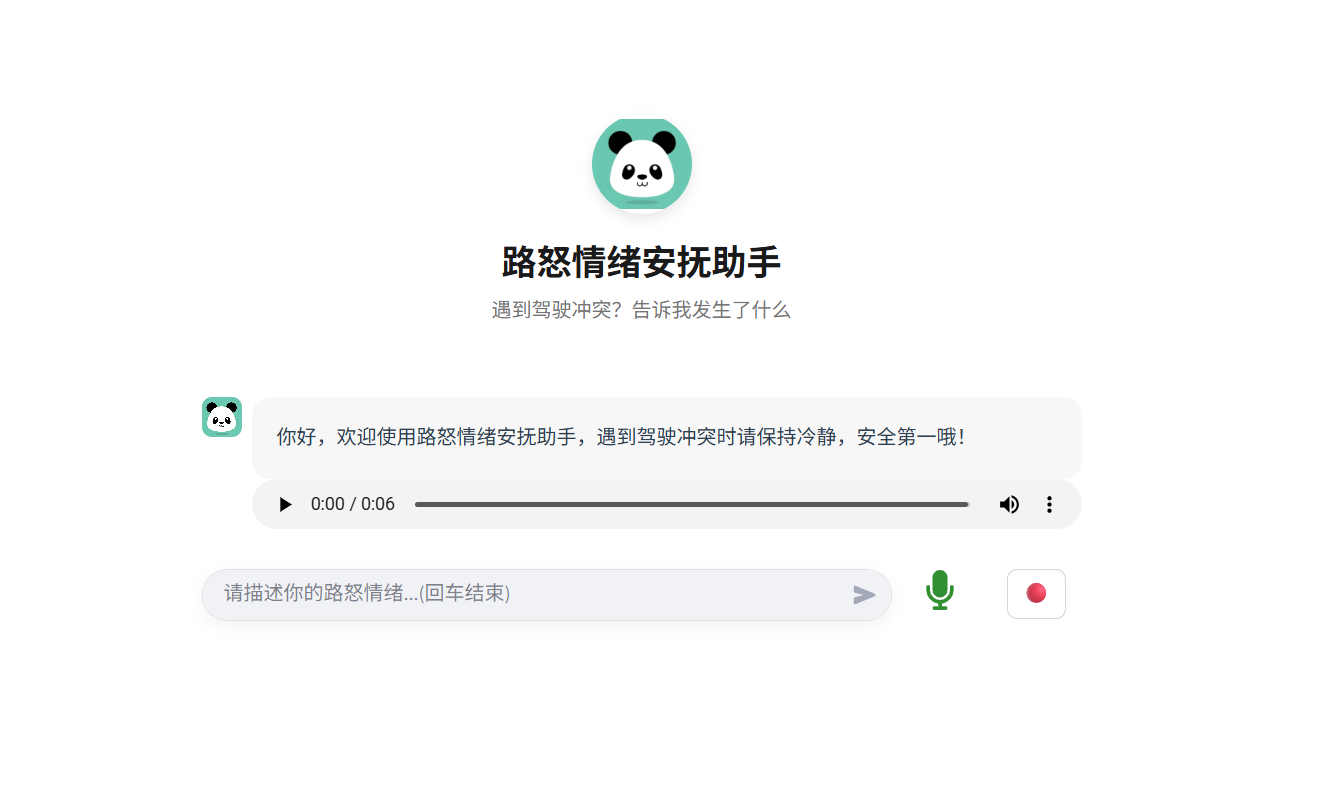

三、实际应用:团队在智能情感交互领域有多项实际运用:与长虹合作推进 “宠物机器人情感识别模块集成服务”,参与天行者二号机器人研发并迁移升级相关技术、拓展场景,还开发支持图片视频双方式检测的情绪识别系统,服务于用户体验优化等场景,为相关领域提供高效工具。

本研究团队在情感计算领域具有深厚积累,负责人任福继教授为全球情感计算领域代表性学者,团队拥有多源情感数据库、智能感知技术与机器人交互平台,并与长虹集团共建联合实验室,推动研究成果在智慧健康与智能座舱中的应用。

情感认知与调节数据库

本项目构建了面向驾驶场景的情感认知与调节多模态数据库,核心数据由自主采集的Synthetic, R³-Ftg 与 Be 数据集构成,同步整合主流公开数据库的访问接口,便于研究者对比与扩展。

自建数据库:

外部资源集成:

为便于研究者开展横向对比与基准测试,本平台提供对以下公开数据库的导航链接及简要介绍:

本数据库以真实驾驶场景下的多模态情绪数据为核心,为车内乘员情绪感知与智能干预系统研发提供可靠数据支撑。

识别与调节模型

本研究围绕面部表情识别(FER)中的核心挑战——标签噪声与数据分布不均衡问题,提出了一系列关键技术创新,构建了兼具鲁棒性与泛化能力的智能情感识别框架。

核心技术成果如下:

ReSup:可靠标签噪声抑制框架

针对真实场景下因主观标注导致的标签噪声问题,提出 ReSup 方法。不同于传统直接判断标签是否含噪的方式,ReSup通过建模预测结果与目标标签之间的差异分布,同步学习噪声与干净样本的联合分布,提升噪声判定的可靠性。进一步引入双网络协同决策机制,利用“双网共错概率低”的特性,通过决策交换与一致性增强,有效减少误判带来的训练干扰,显著提升模型在含噪数据下的学习效率与稳定性。

Co-dance with Ambiguity:面向模糊性的鲁棒识别范式

从“与模糊性共舞”的视角出发,系统性地将标签不确定性建模为可优化的学习过程。ReSup方法作为其核心实现,不仅抑制噪声影响,更通过动态调整样本权重,使模型在复杂、模糊的驾驶环境中具备更强的鲁棒性与适应能力。

基础模型构建:合成数据驱动的通用表达识别

针对真实数据集中存在的类别不平衡(如“恐惧”、“厌恶”样本稀少)问题,提出基于人工可控方式生成大规模标准化面部表情数据集的方案。利用此类高质量、无噪声、均衡分布的合成数据进行无监督预训练,构建通用的面部表情基础模型。该模型可通过微调高效适配于智能座舱情绪识别、人机交互情感反馈等下游任务,大幅提升模型的泛化能力与实际落地价值。

本模块研究成果形成了“噪声抑制 → 模型鲁棒 → 基础模型泛化”的技术闭环,为高精度、高可靠性表情识别提供了坚实的理论与技术支撑。

查看模型详情实际应用

团队在智能情感交互领域有多项实际运用:与长虹合作推进 “宠物机器人情感识别模块集成服务”;参与天行者二号机器人研发,迁移升级该技术,延续 “精准感知 - 智能反馈” 逻辑并拓展场景;还开发情绪识别系统,支持图片视频双方式检测,服务于用户体验优化等场景,为相关领域提供高效工具。

查看应用案例